“Bir siteyi hızlandırmak yalnızca kullanıcı deneyimini iyileştirmez; Googlebot’un siteyi daha hızlı ve daha sık taramasını da sağlar.” – Google Webmasters

Bu cümle genellikle performans optimizasyonu bağlamında okunur. Ama aslında çok daha büyük bir gerçeğe işaret eder:

Tarama bütçesi, SEO’nun teknik bir alt detayı değil; indekslenmenin çalışmasını sağlayan yakıttır.

Google her siteye sınırsız zaman ve istek ayırmaz. Aksine, her site için görünmeyen ama son derece gerçek bir kaynak tahsisi vardır. Bu kaynak şudur:

Tarama bütçesi = Googlebot’un sitenize ayırdığı zaman + yapabileceği istek kredisi

Ve bu bütçe nasıl kullanılırsa, Google’ın sitenizi nasıl “okuduğu” da öyle şekillenir. Buradaki kritik ayrımı netleştirelim:

Tarama, indeksleme değildir.

Bir sayfanın taranması, Google’ın o sayfayı dizine ekleyeceği anlamına gelmez. Ama taranmayan bir sayfanın indekslenme şansı da yoktur. İşte bu yüzden tarama bütçesi meselesi, “kaç sayfam taranıyor?” sorusundan çok daha fazlasıdır. Asıl mesele şudur:

Aynı tarama bütçesiyle Googlebot’a gerçekten değerli sayfalarınızı mı gösteriyorsunuz, yoksa zamanını filtreler, parametreler ve işe yaramayan URL’lerle mi harcatıyorsunuz?

Bu rehberde tarama bütçesini bir metrik olarak değil, bir verimlilik problemi olarak ele alacağız. Ne zaman gerçek bir sorun olduğunu, ne zaman sadece yanlış okunduğunu ve en önemlisi nereden başlamanız gerektiğini netleştireceğiz.

İçindekiler

Toggle- Tarama Bütçesi Her Site İçin Problem mi?

- Googlebot Bütçeyi Nasıl Belirler? (2 Ana Sütun)

- Tarama Bütçesi Nerede Boşa Gider? (Gizli Tüketiciler)

- Teşhis: Tarama Bütçesi Sorunu mu, Verimlilik Sorunu mu?

- Tarama Bütçesi Optimizasyonu Reçetesi: Önce Neyi Düzeltmeliyim?

- Tarama Bütçesi Optimizasyonu Reçetesi: Önce Neyi Düzeltmeliyim?

- Tarama Bütçesi ile İlgili Sık Sorulan Sorular (FAQ)

Tarama Bütçesi Her Site İçin Problem mi?

Kısa cevap: Hayır. Ama yanlış yerde arandığında, gerçek problemi görünmez kılar.

Küçük ve Orta Ölçekli Siteler : Çoğu küçük site için sorun genellikle tarama bütçesi değil, tarama verimliliği ve önceliklendirme problemidir.

- URL sayısı sınırlıdır

- Googlebot siteyi rahatça tarayabilir

- Ama botun vakti önemsiz veya tekrarlayan sayfalarda harcanıyordur

- Kritik sayfalar yeterince güçlü iç link ve sinyal alamıyordur

Bu durumda mesele “Google beni neden taramıyor?” değil, “Google tararken yanlış yerlere mi bakıyor?” sorusudur.

Büyük Siteler (Gerçek Risk Alanı) : Tarama bütçesi problemleri asıl olarak şu yapılarda ortaya çıkar:

- E-ticaret siteleri

- İlan / emlak / otomotiv platformları

- Haber siteleri

- Çok kategorili ve filtreli büyük blog yapıları

Bu tür sitelerde sorun, Googlebot’un isteksizliği değil; kaynakların çok hızlı tüketilmesidir.

Hızlı Eşik Check: Risk Altında mısınız?

Aşağıdaki sinyallerden birkaçını görüyorsanız, tarama bütçesi sizin için gerçek bir konu olabilir:

- Binlerce (hatta on binlerce) URL üreten yapı

- Filtreler, sıralamalar ve parametrelerle çoğalan URL’ler

- Günlük veya çok sık içerik eklenen site yapısı

- Önemli sayfaların “keşfedildi ama dizine eklenmedi” olarak beklemesi

- İndekslenmeyen stratejik sayfa sayısında artış

Bu noktada mesele artık teorik değildir. Googlebot’un neyi taradığı ve neyi görmezden geldiği, doğrudan görünürlüğünüzü belirler.

Googlebot Bütçeyi Nasıl Belirler? (2 Ana Sütun)

Google tarama bütçesini tek bir sinyale bakarak belirlemez. Karar, iki temel mekanizmanın birlikte çalışmasıyla oluşur.

- Crawl Rate Limit (Tarama Hızı Limiti) : Bu, Googlebot’un sitenizi ne kadar hızlı tarayabileceğiyle ilgilidir. Google, sitenizin altyapısını zorlamak istemez. Sunucu yavaşsa, sık sık 5xx hataları veriyorsa ya da istekler timeout’a düşüyorsa, bot otomatik olarak geri çekilir. Bu bir ceza değildir; bir koruma refleksidir. Basitçe: Site ne kadar stabil ve hızlıysa, Googlebot o kadar agresif tarayabilir. Yavaşlık ve hatalar arttıkça tarama temposu düşer, bütçe fiilen daralır.

- Crawl Demand (Tarama Talebi) : Bu sütun ise Google’ın neyi taramak istediği ile ilgilidir. Her sayfa aynı değerde görülmez. Popüler sayfalar, sık güncellenen içerikler, güçlü iç link alan URL’ler ve net “önem” sinyali taşıyan sayfalar daha fazla talep görür. Kısacası Googlebot, sınırlı zamanını “muhtemelen değerli” olan sayfalara harcamak ister. İç linkleme, güncellik ve sayfa otoritesi burada belirleyici olur.

Bu iki mekanizmayı tek bir çerçevede düşünmek gerekir:

Siten hızlıysa daha çok taratabilirsin.

Önemliysen daha sık taranırsın.

Tarama bütçesi sorunlarının büyük kısmı, bu iki sütundan birinin zayıf olmasından değil; ikisinin birlikte optimize edilmemesinden kaynaklanır.

Tarama Bütçesi Nerede Boşa Gider? (Gizli Tüketiciler)

Tarama bütçesi çoğu zaman tek bir ayar yüzünden değil, birden fazla küçük “kontrolsüz alanın” birleşimiyle tükenir.

Googlebot için sorun “sayfa sayısı” değil; hangi URL’lerin tekrar tekrar keşfedildiği ve hangilerinin gerçekten değer ürettiğidir.

Aşağıdaki alanlar, bütçeyi sessizce emen en yaygın gizli tüketicilerdir.

URL Parametreleri ve Filtreleme (Faceted Navigation)

Sorun:

Renk, beden, fiyat, sıralama gibi filtrelerin her kombinasyonu yeni bir URL üretir.

Belirti:

Aynı kategori veya ürün içeriğinin yüzlerce varyasyonu taranır.

Search Console’da taranan URL sayısı artar ama indekslenen değerli sayfa sayısı artmaz.

Neden:

Google bu URL’leri “ayrı sayfa” olarak görür çünkü:

- Canonical sinyali net değildir

- Filtre URL’leri iç linklerle sürekli beslenir

- Noindex verilse bile keşif döngüsünden düşmez

Sonuç olarak kopya sayfa üretimi, tarama bütçesini doğrudan emer.

Ne yapmalı:

Hangi filtrelerin indekslenebilir, hangilerinin yalnızca kullanıcıya hizmet edeceği netleştirilmelidir. Canonical, noindex ve iç linkleme birlikte düşünülmeden yapılan her çözüm yarım kalır.

Site İçi Arama Sonuç Sayfaları

Sorun:

/?s= veya /search?q= gibi URL’ler sınırsız kombinasyon üretir.

Belirti:

Googlebot’un taradığı ama organik görünürlük üretmeyen yüzlerce URL.

Neden:

Bu sayfalar:

- Genellikle sitemap dışıdır

- İç linklerle veya parametrelerle keşfedilir

- SEO açısından benzersiz bir değer sunmaz

Googlebot bu sayfaları tarayarak hiçbir indeks getirisi olmayan istekler harcar.

Ne yapmalı:

Site içi arama sonuçları, tarama ve indeksleme denkleminden net biçimde ayrılmalıdır. “Noindex verdim bitti” yaklaşımı yeterli değildir; keşif kaynakları da kontrol edilmelidir.

Yönlendirme Zincirleri ve Loop’lar

Sorun:

Bir URL’in doğrudan hedefe gitmeyip A → B → C şeklinde ilerlemesi.

Belirti:

Tarama raporlarında aynı içeriğe ulaşmak için birden fazla istek.

Neden:

Googlebot her yönlendirmeyi ayrı bir tarama isteği olarak ele alır.

Zincir uzadıkça, her sayfa daha “pahalı” hale gelir.

Ne yapmalı:

Yönlendirmeler tek adımda ve net hedefe yapılmalıdır. Loop’lar yalnızca bütçeyi değil, tarama güvenini de bozar.

Soft 404 ve İnce İçerik Sayfaları

Sorun: Teknik olarak 200 OK dönen ama içerik açısından neredeyse boş sayfalar.

Belirti: “Tarandı” ama indekslenmeyen, düşük değerli URL’ler.

Neden: Google bu sayfaları taramaya devam eder çünkü teknik olarak erişilebilirdir. Ancak içerik kalitesi sinyali zayıf olduğu için dizine alınmaz.

Bu durum:

- Tarama bütçesini yakar

- Site genel kalite algısını aşağı çeker

Ne yapmalı: Bu sayfalar ya gerçekten iyileştirilmeli ya da sistemden çıkarılmalıdır. Noindex her zaman yeterli değildir; bazen içerik gerçekten kaldırılmalıdır.

Kırık Linkler ve 404 Havuzları

Sorun:

İç linklerde veya sitemap’te 404 dönen URL’lerin bulunması.

Belirti:

Tarama istatistiklerinde yüksek 404 oranı.

Neden:

Googlebot, iç link veya sitemap üzerinden ulaştığı her 404 için bir istek harcar.

Bu isteklerin hiçbir getirisi yoktur.

Ne yapmalı:

404’ler özellikle iç link ve sitemap seviyesinde sistematik olarak temizlenmelidir. “Zaten 404” demek, bütçe israfını görmezden gelmektir.

Gereksiz JS Render Ağırlığı

Sorun:

Kritik içeriğin ve linklerin JavaScript render sürecine kalması.

Belirti:

Googlebot sayfayı tarar ama gerçek içeriğe geç ulaşır.

Neden:

Her render, taramayı daha maliyetli hale getirir. Bu durum küçük sitelerde fark yaratmayabilir; ancak büyük yapılarda tarama verimliliğini ciddi biçimde düşürür.

Ne yapmalı:

Kritik keşif ve linkleme mümkün olduğunca render öncesi erişilebilir olmalıdır. Her site için şart değildir ama büyük sitelerde ihmal edilemez.

Bu Bölümün Ana Mesajı

Tarama bütçesi çoğu zaman:

- “Google az tarıyor” problemi değildir

- Google yanlış şeyleri tarıyor problemidir

Ve bu yanlışlık genellikle tek bir ayardan değil, sinyallerin birlikte kontrol edilmemesinden doğar.

Teşhis: Tarama Bütçesi Sorunu mu, Verimlilik Sorunu mu?

Tarama bütçesi konuşulurken yapılan en yaygın hata, çözümü teşhisten önce aramaktır. Oysa Google tarafında yaşanan birçok problem, “daha fazla tarama” ihtiyacından değil; taramanın yanlış yerlere harcanmasından kaynaklanır.

Bu yüzden doğru teşhis, tek bir rapora bakarak değil; tarama davranışı ile indeksleme sonucunu birlikte okuyarak konur.

Search Console’da Bakılacak Yerler

Teşhisin ilk adımı, Search Console’daki Ayarlar → Tarama İstatistikleri raporudur. Bu rapor, Googlebot’un sitenizle kurduğu ilişkinin temposunu ve kalitesini gösterir.

Burada bakılan şey yalnızca “kaç istek yapıldı?” değildir.

Önce toplam tarama isteği incelenir. Artış veya düşüş tek başına anlamlı değildir; asıl mesele bu isteklerin nasıl sonuçlandığıdır.

Ardından yanıt kodları dağılımına bakılır. Tarama isteği artarken 404 veya 5xx oranları da artıyorsa, bu durum Googlebot’un zamanının önemli bir kısmını boşa harcadığını gösterir. Bu bir bütçe artışı değil, açık bir verimsizliktir.

Dosya türleri de önemli bir sinyaldir. HTML yerine ağırlıklı olarak JS, JSON veya gereksiz kaynakların taranması, botun odağının yanlış yerde olduğunu düşündürür.

Son olarak ortalama yanıt süresi değerlendirilir. Yanıt süreleri yükseliyorsa, crawl rate limit devreye girer. Googlebot bilinçli olarak yavaşlar ve bu durum tarama bütçesini fiilen kısıtlar.

Basit bir örnekle özetlemek gerekirse: Tarama isteği artıyor ama hata oranı da artıyorsa → sorun tarama değil, verimliliktir.

İndeksleme Raporu ile Çapraz Kontrol

Tarama İstatistikleri bize Google’ın ne yaptığını, İndeksleme raporu ise bu yapılanların ne işe yaradığını gösterir.

Bu iki rapor birlikte okunmadan yapılan yorumlar eksik kalır.

Özellikle iki durum kritik önemdedir:

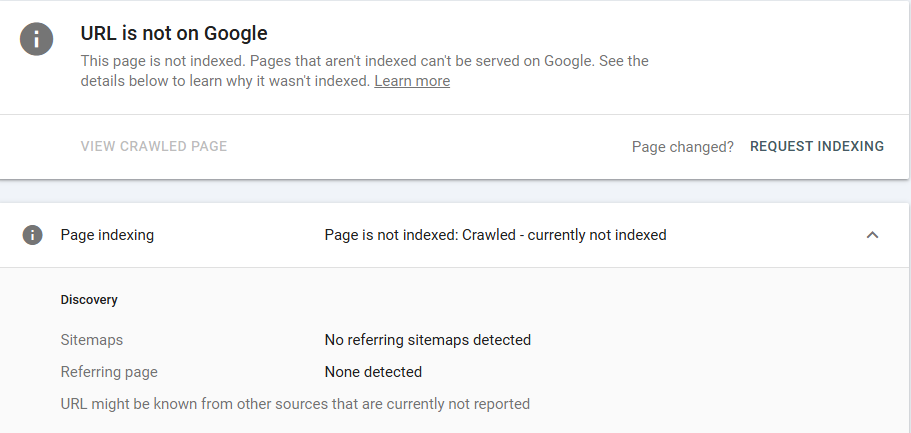

“Keşfedildi – şu anda dizine eklenmedi”

Google URL’yi biliyordur ama taramaya öncelik vermiyordur.

Bu genellikle iç linkleme, önceliklendirme veya site içi sinyal zayıflığına işaret eder.

“Tarandı – şu anda dizine eklenmedi”

Google sayfayı görmüş ama dizine almamayı seçmiştir.

Bu noktada problem çoğu zaman tarama bütçesi değildir; kalite, tekrar eden içerik veya sinyal çelişkisidir.

Burada okuyucuya net bir mesaj vermek gerekir:

Bazen problem tarama değil, indekslenmeye değer bulunmamaktır.

Log Analizi Neden Oyunu Değiştirir? (Opsiyonel ama Güçlü)

Search Console, tarama davranışının özetini verir. Log dosyaları ise gerçek davranışı gösterir.

Log analizi sayesinde şunlar net biçimde görülür:

- Googlebot’un en çok vakit harcadığı URL grupları

- Parametreli veya filtreli sayfaların bütçeyi ne kadar emdiği

- Kritik sayfaların gerçekten ne sıklıkla tarandığı

Özellikle büyük sitelerde, “tarama bütçesi sorunu var mı?” sorusunun kesin cevabı log verisi olmadan tam olarak verilemez.

Teşhisin Ana Çıktısı

Bu bölümün sonunda ulaşılması gereken netlik şudur:

- Sorun gerçekten tarama bütçesi mi?

- Yoksa tarama var ama yanlış yerlere mi gidiyor?

- Müdahale altyapıya mı, içerik yapısına mı, sinyal uyumuna mı yapılmalı?

Bu netleşmeden atılan her adım, sorunu çözmek yerine yer değiştirmesine neden olur.

Tarama Bütçesi Optimizasyonu Reçetesi: Önce Neyi Düzeltmeliyim?

Tarama bütçesi optimizasyonu, “her şeyi düzeltmeye çalışmak” değildir.

Doğru yaklaşım, en çok bütçeyi tüketen alanlardan başlayarak, Googlebot’un odağını kademeli olarak toparlamaktır.

Aşağıdaki sıralama, en yüksek etkiyi en kısa sürede yaratacak şekilde ilerler.

- Parametre ve filtre yönetimi (en yüksek ROI) : Filtre ve parametre URL’leri, bütçeyi en hızlı tüketen alanlardır. Canonical ile ana versiyon netleştirilmeli; noindex ve robots.txt farkı doğru okunmalıdır: noindex indekslemeyi etkiler, robots keşfi. Faceted yapılarda hangi filtrelerin indeksleneceği, hangilerinin yalnızca kullanıcıya hizmet edeceği açık bir kural setine bağlanmalıdır.

- Sitemap temizliği (sadece değerli 200 OK sayfalar) : Sitemap, Google’a “öncelik listesi” verir. Redirect, 404, noindex veya canonical dışı sayfaların sitemap’te yer alması, botun zamanını bilinçli olarak boşa harcamaktır. Sitemap yalnızca gerçekten indekslenmesini istediğiniz URL’leri içermelidir.

- Sunucu performansı ve hata kodları : 5xx hataları ve timeout’lar crawl rate limit’i doğrudan tetikler. Basit performans iyileştirmeleri, CDN ve cache kullanımı, TTFB’nin düşürülmesi; Googlebot’un tarama temposunu artıran en temel faktörlerdir.

- İç linkleme: botu paranın olduğu yere götür : Yetim sayfalar, Google için “önemsiz” sinyali üretir. En değerli kategori ve landing sayfaları, daha kısa tıklama mesafesiyle ve daha fazla iç linkle desteklenmelidir. Bot, site içi link yapısına bakarak neyin önemli olduğuna karar verir.

- İnce içerik ve kopya sayfaları azalt : Düşük değerli veya tekrar eden sayfalar, hem bütçeyi hem kalite sinyalini aşağı çeker. Bazı durumlarda noindex yeterlidir; ancak bazı içeriklerin gerçekten birleştirilmesi veya kaldırılması gerekir. Amaç sayıyı azaltmak değil, ortalama değeri yükseltmektir.

Bu bölümün ana mesajı şudur: Tarama bütçesi optimizasyonu, teknik bir ayar listesi değil; kaynak yönetimi problemidir.

Tarama Bütçesi Optimizasyonu Reçetesi: Önce Neyi Düzeltmeliyim?

Tarama bütçesi optimizasyonu, tek tek ayarları kurcalamak değil; Googlebot’un tarama davranışını sistematik olarak yönlendirme işidir.

Bu yüzden yapılacak müdahaleler, “etkisi en yüksek olandan” başlanarak ele alınmalıdır. Aksi hâlde iyileştirmeler ya fark yaratmaz ya da yanlış alanlara yapılır.

Parametre ve Filtre Yönetimi (En Yüksek ROI)

Faceted navigation, tarama bütçesinin en agresif tüketicisidir.

Screaming Frog ile yapılan bir crawl’da, genellikle aynı kategori içeriğinin onlarca parametreli varyasyonunun tarandığı görülür.

Burada kritik ayrım şudur:

Canonical konsolidasyon sinyalidir,

noindex indeksleme sinyalidir,

robots.txt ise keşfi etkiler.

Bu sinyaller çeliştiğinde Googlebot, URL’leri taramaya devam eder. Bu nedenle hangi filtrelerin indeksleneceği, hangilerinin yalnızca UX amacıyla var olacağı net bir kural setine bağlanmalıdır.

Sitemap Temizliği (Sadece Değerli 200 OK URL’ler)

Sitemap, Google’a “öncelikli tarama listesi” sunar.

Screaming Frog veya GSC sitemap raporları incelendiğinde, redirect, 404, noindex veya canonical dışı URL’lerin sitemap’te yer alması sık görülen bir hatadır.

Bu durum Googlebot’a çelişkili bir mesaj verir: “Bu sayfayı taramanı istiyorum ama indeksleme.”

Sonuç olarak bot, zamanını yanlış URL’lerde harcar. Sitemap yalnızca kanonik, indekslenebilir ve stratejik sayfalardan oluşmalıdır.

Sunucu Performansı ve Hata Kodları

Crawl rate limit, sunucu davranışına son derece duyarlıdır.

Log dosyaları veya GSC Tarama İstatistikleri incelendiğinde 5xx, timeout veya dalgalı yanıt süreleri görülüyorsa, Googlebot otomatik olarak tarama hızını düşürür.

Burada yapılan iyileştirmeler genellikle karmaşık değildir:

CDN kullanımı, cache politikaları ve TTFB optimizasyonları, tarama kapasitesini doğrudan etkiler. Bu alan, teknik SEO’nun en “sessiz ama etkili” noktalarından biridir.

İç Linkleme: Botu Öncelikli URL’lere Yönlendirmek

Googlebot, site içi link yapısını bir öncelik haritası olarak okur.

Screaming Frog ile yapılan crawl’da yüksek tıklama derinliğine sahip (deep) ama stratejik sayfalar görülüyorsa, bu bir sinyal problemidir.

Yetim sayfalar, Google açısından düşük öncelik anlamına gelir.

En değerli kategori ve landing sayfaları, ana navigasyon ve bağlamsal linklerle daha kısa tıklama mesafesine çekilmelidir. Bu, crawl demand’i doğrudan artırır.

İnce İçerik ve Kopya Sayfaların Azaltılması

Tarama bütçesi yalnızca teknik URL’lerde değil, düşük değerli içeriklerde de tükenir.

Screaming Frog, GSC ve indeksleme raporları birlikte okunduğunda; taranan ama indekslenmeyen ince içerik kümeleri net biçimde ortaya çıkar.

Bazı durumlarda noindex yeterlidir. Ancak özellikle büyük sitelerde, gerçekten değeri olmayan içeriklerin kaldırılması veya birleştirilmesi, hem tarama bütçesini rahatlatır hem de site genel kalite sinyalini güçlendirir.

Kapanış: Tarama Bütçesi Bir Metrik Değil, Bir Kaynak Yönetimidir

Tarama bütçesi, takip edilen bir metrikten çok yönetilmesi gereken bir kaynaktır. Bu rehber boyunca anlattığımız her şey, aslında tek bir soruya çıkar:

Googlebot, zamanını gerçekten değerli URL’lerde mi harcıyor?

Aşağıdaki kısa liste, durumu hızlıca netleştirmeniz için pratik bir kontrol çerçevesi sunar:

- Search Console → Tarama İstatistikleri raporunu kontrol edin

- Parametre ve filtre URL’lerini gruplandırarak görün

- Sitemap’te yalnızca kanonik, 200 OK ve indekslenebilir sayfaların yer aldığından emin olun

- 404, soft 404 ve redirect chain içeren URL’leri temizleyin

- Yetim sayfaları ve iç linkleme boşluklarını tespit edin

- Sunucu yanıt süreleri ve 5xx / timeout sinyallerini gözden geçirin

- Tarama verilerini İndeksleme raporuyla çapraz okuyun

Bu adımların amacı “daha çok tarama” almak değil; aynı taramayla daha fazla değer üretmektir.

Tarama bütçesi sorunlarının büyük kısmı, ayar eksikliğinden değil; teşhis eksikliğinden kaynaklanır.

Veri vardır ama nasıl okunacağı net değildir. Bu noktada problem Google’da değil, veriye bakış biçimindedir.

Eğer isterseniz; Search Console’daki Tarama İstatistikleri ile İndeksleme raporlarını birlikte okuyup, hangi URL gruplarının tarama bütçesini tükettiğini 30 dakikalık bir analizle netleştirebiliriz.

Amaç daha fazla teknik detay değil; doğru yere odaklanmaktır.

Tarama Bütçesi ile İlgili Sık Sorulan Sorular (FAQ)

Tarama bütçesi nedir?

Tarama bütçesi, Googlebot’un web sitenizi taramak için ayırdığı zaman ve istek kapasitesini ifade eder. Google her siteyi sınırsız şekilde taramaz; kaynaklarını verimli kullanmak ister. Bu yüzden hangi sayfaların ne sıklıkla taranacağı bir öncelik meselesidir. Tarama bütçesi, indekslemenin ön koşuludur ama indeksleme garantisi değildir.

Tarama bütçesi her site için önemli mi?

Hayır, her site için kritik bir problem değildir. Küçük ve sınırlı URL sayısına sahip sitelerde sorun genellikle tarama bütçesi değil, tarama verimliliğidir. Ancak e-ticaret, ilan, haber veya filtreli büyük sitelerde tarama bütçesi doğrudan görünürlüğü etkileyebilir. Bu yüzden önce sitenin yapısı doğru değerlendirilmelidir.

Tarama bütçesi ile indeksleme arasındaki fark nedir?

Tarama, Googlebot’un bir sayfayı ziyaret etmesidir; indeksleme ise bu sayfanın Google dizinine eklenmesidir. Bir sayfa taranıp indekslenmeyebilir. Bu durum genellikle kalite, tekrar eden içerik veya sinyal çelişkilerinden kaynaklanır. Bu yüzden tarama sorunları her zaman indeksleme sorunu anlamına gelmez.

Tarama bütçesi neden boşa gider?

Tarama bütçesi en sık URL parametreleri, filtreler, site içi arama sayfaları, redirect zincirleri ve soft 404’ler yüzünden boşa harcanır. Googlebot, değer üretmeyen bu URL’leri tararken gerçekten önemli sayfalara daha az zaman ayırır. Sorun Google’ın az taraması değil, yanlış yerleri taramasıdır.

Tarama bütçesi sorununu nasıl anlarım?

Search Console’daki Tarama İstatistikleri raporu ile İndeksleme raporu birlikte okunmalıdır. Tarama isteği artarken 404, 5xx veya “tarandı – dizine eklenmedi” sayıları da artıyorsa, bu verimsiz taramaya işaret eder. Gerekli durumlarda log analizi, Googlebot’un gerçekten nerede zaman harcadığını net biçimde gösterir.